推特上时常会出现一些种族歧视的言论。不过最近一项研究表明,利用“推特机器人”(译者注:即人工语c,也就是语言角色扮演),对发表这些言论的人做出回应,可以有效抑制种族歧视的言论。有趣的是,机器人扮演成白人的时候最有效果,这一点也意味深长,很引人注目。

在纽约大学政治系进修博士课程的Kevin Munger从推特中抽出231个带有所谓“N字头”,也就是对黑人的蔑称——“Nigger(黑鬼)”词语的账号。然后在这些账号发表种族歧视言论的时候,回复劝阻的内容,然后调查对方的反应。

挑选这些账号的时候,Munger设立了一些条件,比如“账号建立超过6个月”、“在Munger追踪账号期间,‘N字头’占该账号全部发言的3%以上”、“账号主人看上去像白人男性”。Munger还特别解释了紧盯白人男性的理由在于,“白人男性是在网上对黑人进行种族歧视相关组织的主力,在政治方面最为突出。”

Munger注册了很多用来检验的假账号。账号的主人设计为很多不同人种,账号粉丝的数量也很分散,让人看不出是假账号。设定粉丝时,Munger从提供僵尸粉的机器人服务商中购买了粉丝。实际上有多少个账号,这是保密的,除了下面两个账号以外都没有被公布。其中一个公开的账号,名字为很多白人使用的传统名字“Greg Jackson”,头像也设定为白人模样。

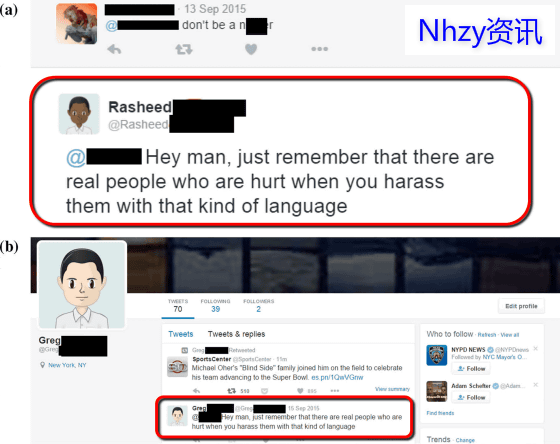

还有一个账号,名字被组合成了黑人经常使用的名字“Rasheed Smith”。配合名字,头像选用了看起来像是黑人用户的图片。无论哪个账号,发言内容都是非公开的。

具体造作按如下流程进行。首先找到带有“nigger”单词的推特,[email protected]/* */,也就是发给谁看的。符合条件的,用特殊算法判断该用户发言是否有攻击性并将其数值化,再选出超过一定数值的账号。然后由人工真实地观察被选中的账号,首先判断该账号的使用人是否是白人,[email protected]/* */,据此判断出不是针对直接认识的人,而是对第三方进行种族歧视攻击的时候,推特机器人就回复劝诫不当言论的内容。

回复内容如下。「@[subject] Hey man, just remember that there are real people who are hurt when you harass them with that kind of language.」(翻译:@对方名称 喂,你要注意,你的这些攻击性语言会伤害到现实中真实存在的人。)诸如此类,机器人会对歧视言论给予忠告。

实验结果证明,抑制歧视言论最有效的,是“使用白人头像,粉丝最多的账号”。比较试验前后被劝诫账号发言的内容,N字头的使用率减少了27%,这说明产生了一定的效果。相反地,使用“白人头像但粉丝少的账号”和“所有黑人账号”的时候,几乎没见什么成效,反而有时候会被对方喷回去。另外,Munger称,很多发表歧视言论的账号,还使用 “玩家门”事件(事件背景为性别歧视)的标签“#GamerGate”;还有很多粉了唐纳德特朗普竞选总统时所开通的账号。这意味着“玩家门”事件和特朗普的支持者有一定关联性,这一点真是令人玩味。

新年伊始,听说有好多同学声称自己去年的读书li...

不知是不是因为今年疫情的缘故,总觉得时间过得...

2020年即将过去,本年度的【好书荐读】系列也迎...